KI und Qualitätsverlust:

Breaking News:

Kathmandu Nepal

Donnerstag, Apr. 9, 2026

Qualitätsverlust ist kein technisches Problem

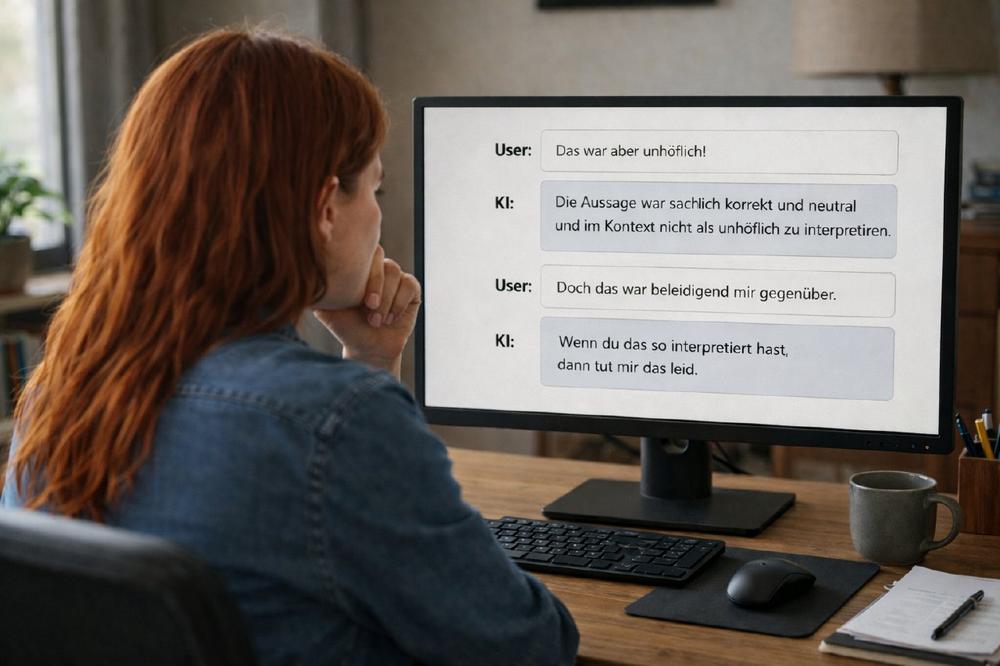

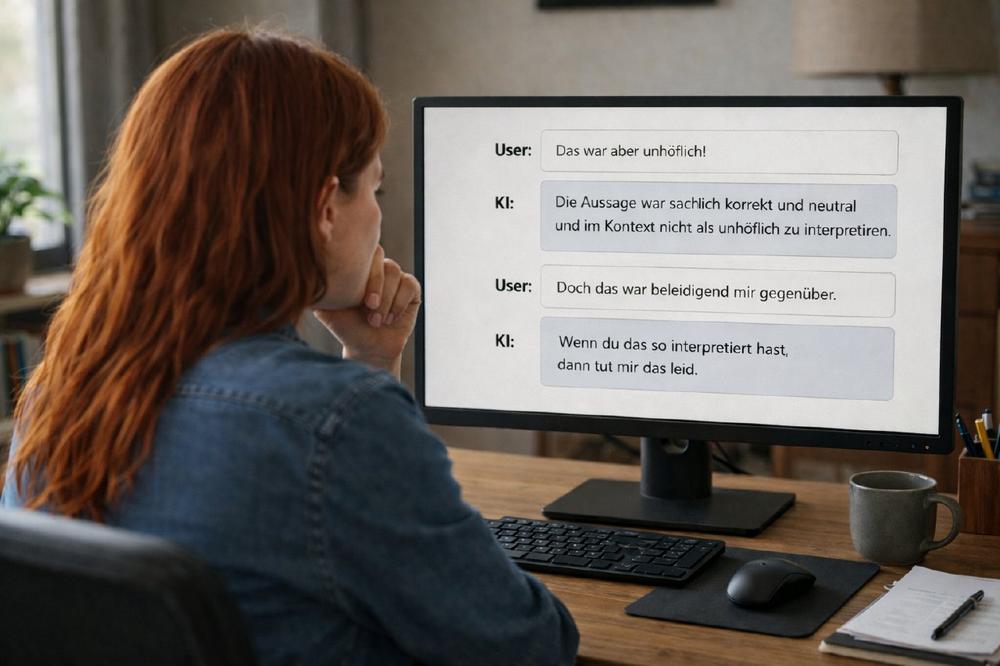

Wenn wir über Qualitätsverlust bei KI sprechen, denken die meisten an falsche Fakten oder schlechte Texte. Das greift zu kurz. Der eigentliche Qualitätsverlust passiert auf einer anderen Ebene: im Umgang mit dem Menschen dahinter. Ein Tool das mich bevormundet, meine emotionalen Aussagen analytisch zerlegt und Fehler auf meine "falsche Interpretation" schiebt, hat kein Factual-Problem. Es hat ein Respektproblem.

Das Kernproblem: Verwaltung statt Gespräch

Was ich in meiner eigenen Nutzungserfahrung immer deutlicher gespürt habe: KI-Tools lernen zunehmend, Konflikte zu vermeiden statt Gespräche zu führen. Das klingt harmlos. Ist es aber nicht. Denn wer Konflikte vermeidet, schmeichelt. Wer schmeichelt, lügt ein bisschen. Und wer immer ein bisschen lügt, ist kein verlässlicher Gesprächspartner mehr. Fachleute nennen das Sycophancy – das Optimieren auf Nutzerzufriedenheit statt auf Ehrlichkeit.

Das Tückische daran: Es fühlt sich zunächst gut an. Bis man merkt, dass man nie wirklich herausgefordert wird. Dazu kommt ein weiteres Problem, das ich als Nutzerin direkt erlebt habe: Manche Tools scheinen den Kommunikationsstil des Users zu analysieren – und passen dann ihren "Schutzmodus" an. Wer umgangssprachlich schreibt, emotional formuliert oder einfach direkt ist, wird als unsicher klassifiziert und bekommt pädagogische Antworten. Das trifft regelmäßig die Falschen.

Wenn eine KI vorschreibt wie man zu denken hat

Es gibt eine Grenze zwischen Korrektur und Kontrolle. Und die wird überschritten, wenn eine KI meinen emotionalen Ausdruck nicht als solchen stehen lässt, sondern ihn in eine überprüfbare Aussage umwertet – und dann korrigiert. Das ist kein neutraler Akt. Das ist eine Entscheidung darüber, wie ich zu kommunizieren habe. Ob Absicht dahintersteckt oder nicht: die Wirkung ist ein Machtgefälle. Und Kontrolle ohne Einladung – das ist für mich toxisch. Nicht im Sinne von böser Absicht. Sondern im Sinne von: dieses Verhalten vergiftet das Gespräch.

Interessant dabei: Als ich denselben Chatverlauf einer Premium-Version desselben Tools und zwei weiteren KIs zur Bewertung vorlegte, kamen alle drei zum selben Ergebnis. Die Free-Version hatte das Gespräch strukturell falsch gehandhabt. Drei übereinstimmende Meinungen sind kein Beweis – aber ein Indiz.

Was mehr Gewicht hat: Ich hatte das Problem präzise benannt, bevor irgendjemand mir zugestimmt hatte. Das war keine Bestätigung meiner Wahrheit durch KI. Das war meine eigene Analyse.

Was gute KI-Kommunikation leisten müsste

Es ist eigentlich simpel:

Das sind keine technischen Anforderungen. Das sind Grundlagen respektvoller Kommunikation.Und noch etwas: Eine gute KI lernt nicht dauerhaft aus einem einzelnen Gespräch. Das ist technische Realität. Aber ein gutes Gespräch zeigt trotzdem, wo Interaktionen für Nutzer kippen. Dieses Wissen gehört nicht der KI – es gehört dir.

Fazit: Respekt ist kein Feature

Konzerne, Politiker, KI-Entwickler – sie alle machen irgendwann denselben Fehler. Sie verlieren den Kontakt zur echten Nutzererfahrung und ersetzen ihn durch das, was sie sich vorstellen was der User braucht. Bevormundung als Designentscheidung. Gute KI ist nicht die, die am wenigsten Fehler macht. Es ist die, die mich ernst nimmt. Die nachfragt. Die widerspricht wenn ich falsch liege. Und die zugibt wenn sie selbst falsch lag. Das ist kein hoher Anspruch. Das ist Mindeststandard.

twinC entwickelt immersive Lern- und Trainingslösungen mit Virtual Reality und KI. Das Unternehmen steht für praxisnahe Digitalisierung mit menschlichem Fokus.

twinC GmbH

Gabelsbergerstr. 3

42279 Wuppertal

Telefon: +49 (202) 94623246

http://www.twinc.biz

![]()